Cultivant sa différence face aux traditionnels radars et caméras, le LiDAR est une technologie de plus en plus sollicitée. La toute jeune start-up française Outsight est l’une des plus actives sur le sujet. Faisons le tour de la question…

« Sans savoir qui ils sont » … le Lidar permet de capturer des informations que d’autres dispositifs ne peuvent pas capturer (ou le font de manière moins optimale). Il suffit de relier les informations capturée par le Lidar à - par exemple - le passage d’une personne devant une caméra. Et là, vu qu’on sait tout ce que « un inconnu » a fait (Lidar) et qu’on peut relier cette personne à une identité (caméra), le discours ne sera plus le même …

J’ai l’impression qu’on a à chaque fois le même discours. Un tracker ne fait pas grand-chose. Par contre quand on croise les informations, ça peut faire peur quand-même …

oui lidar + caméra + reconnaissance faciale = on te traque partout avec une précision diabolique. Mais lidar sans caméra ça passe…

Oui…

Après, dans le cadre de la gestion des flux, comme ici dans un aéroport, il y aura toujours débat. Car si le LiDAR est d’une grande utilité, on ne peut pas le soustraire aux caméras, pour des raisons de sécurité. Et il est difficile aujourd’hui de priver les endroits de masse des dispositifs traditionnels de surveillance… Ensuite, tout est une question de réglementation.

Vous occultez complètement les capteurs TOF (Time Of Flight) qui équipent de nombreux smartphones Android depuis quelques années déjà et qui permettent également de mesurer des distances sur une matrice de pixels. Avec l’application 3D Live Scanner, il est par exemple possible de numériser en direct des salles ou des objets. Au départ, ce capteur était essentiellement utilisé pour ajouter de jolis effets de bokeh aux photographies ; avec le projet Tango de Google il est possible d’aller plus loin, notamment pour la réalité virtuelle ou la réalité augmentée.

« Et grâce au temps de vol (soit le temps entre l’aller et le retour), on sait connait la distance, parce que la vitesse de la lumière est connue »

Une petite erreur « on sait connaître » ou « on connaît ».

« L’avantage, c’est que ce processus garanti une vraie anonymisation des sujets. » Xi Jinping a déjà dit « non merci »…

Pour info, cela fait bientôt 3 ans que google a mis fin au projet Tango

En fait, c’est un sujet compliqué, non pas à cause du fonctionnement, mais car il y a pleins de technologies différences, certaines se regroupe, d’autre se ressemble, d’autre n’ont qu’une petite différence, et pire encore, certaines sont considéré comme tel ou tel type selon qui on demande…

On retrouve plusieurs méthodes pour obtenir des informations tri-dimensionnelles d’un objet.

A noté qu’il existe également des façons de faire avec une seule caméra et de l’intelligence artificielle, et bien que ça comprend plusieurs façons différentes, en général ça tombe plus ou moins presque toujours sous soit :

-

De l’AI qui calcule les informations de profondeur (depth data) d’une vidéo, comme vue ici :

https://www.youtube.com/watch?v=QSVrKK_uHoU

La façon dont ça fonctionne est l’équivalent de comme ce gif pris d’une image en 2D donne l’illusion d’une image en 3D :

Comme dit dans la vidéo (bien qu’en Anglais), avec assez de temps, une personne pourrait avec cette image rentrer manuellement les informations de profondeur de l’image. -

Soit la photogrammétrie, là c’est plus un type scanner que juste profondeur, le principe consiste à prendre pleins de photo de pleins d’angles de l’objet et d’utiliser un logiciel pour sortir un modèle 3D, explications ici :

https://www.youtube.com/watch?v=_5eLJNKL8ZY

Une version poussée à l’extrême ici qui permet de réaliser un modèle 3D sur 360° :

https://www.youtube.com/watch?v=9wnmeoBEfzs

Et une version plus simple, et accessible pour faire ce genre de modèle 3D à 360° ce fait avec pleins de photo, comme la version précédente, mais avec un seul appareil que l’on va utiliser pour prendre le sujet tout autour, un résultat pratique c’est le visionneur 3D de smartphones de GSMArena :

https://www.gsmarena.com/gsmarena_labs_3d_models_let_you_examine_the_phones_in_our_database_like_never_before-news-44436.php

Et comme dit dans la première vidéo sur la Photogrammétrie, à une époque on faisait cela manuellement, donc c’est assez proche de comme l’IA le fait, qui, comme précisé, un humain pourrait faire, bien que le temps que ça prendrait pour le faire dans une vidéo serrait bien trop long pour être pratique.

Et des versions utilisant l’IA existent également :

https://www.youtube.com/watch?v=nCpGStnayHk

L’autre méthode pour obtenir de la 3D c’est la stéréoscopie, bien que cela demande beaucoup de puissance de calcul car il faut que pour chaque images, chaque pixels soit identifier sur les deux caméras, et grâce à cela, on obtient de la triangulation entre les deux caméras et le point duquel on va pouvoir déterminer la position.

L’idéal avec la stéréoscopie c’est pour ensuite le visionner tel quel, en tant que film/vidéo/VR.

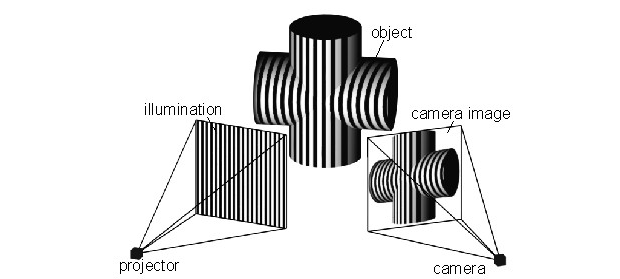

On retrouve également la méthode du Structured Light, c’est le même système que le Face ID de l’iPhone utilise, également présent sur les Pixel 4 et 4XL de Google, le Huawei Mate 30 Pro et le Oppo Find X.

Le but consiste à projeter un schéma précis, que ce soit une grille de points, des lignes, des cercles, etc.

On va obtenir ensuite un modèle 3D de l’objet en faisant de la triangulation entre chaque points/lignes etc, le projecteur, et la caméra, la façon dont la surface en 3D va faire déformer ou déplacer les points contrairement à une surface plane permet de calculer le relief :

Et bien que plus lent que les systèmes à base de ToF, c’est largement plus précis.

C’est plus souvent utiliser pour scanner que pour déterminer en temps réel la profondeur, et pour des scanners précis, on va utiliser une version dynamique ou le schéma va changer, souvent c’est des lignes qui vont simplement changer d’épaisseur et d’espacement comme vue ici :

https://www.youtube.com/watch?v=U0Q9QnYRsoU

Certains hybride existe, tel que les sytème de stéréoscopie active qui utilise deux caméra et un projecteur de type Structured Light :

Pour ce qui est du « Light Field », c’est plus simple qu’on pourrait le penser.

Il s’agit en fait d’utiliser soit pleins de caméra en une, soit un capteur qui va enregistrer les images de lentilles la découpant en pleins de sous images.

La particularité c’est que chaque image à un focus différent, ce qui permet de changer le focus une fois la photo prise, car en fait on a juste pris pleins de photo avec un focus différent, et on change juste d’une à l’autre, mais grâce à cela, en déterminant quels sont les objets en focus et lesquels ne le sont pas, on va pouvoir obtenir des informations de distance et donc, de profondeur.

L’exemple le plus connu est les caméras de Lytro :

https://www.youtube.com/watch?v=C11Dc-K8eP8

Et maintenant, avant de parler des LiDAR, parlons des ToF, qui explique déjà tout des LiDAR par eux même.

ToF ou Time of Flight signifie « temps de vol », et contrairement à ce que l’on pense, beaucoup de choses autre que la lumière peuvent être utilisé pour faire un capteur de type ToF :

En fait, même des neutrons peuvent être utilisés :

Le principe est très simple, on envoie un élément qui voyage à vitesse constante, et on regarde le temps que celui-ci met pour revenir.

Du moins, en théorie, mais c’est là que ça devient compliqué, car les choses ne sont pas si simple.

On retrouve deux types de ToF.

Le premier étant celui mesurant simplement le temps que met la lumière à faire un aller-retour entre l’émetteur et le capteur.

Le deuxième, lui, que l’on appel FMCW, utilise les différences de phases, en gros il pulse extrêmement rapidement un schéma précis, et va mesurer la différence entre le schéma qu’il émet actuellement et celui qu’il vient de recevoir.

Ce deuxième type permet de mesurer la vitesse d’un objet grâce à l’effet Doppler en mesurant la modification de cette phase.

Sur cette image Delta t (Δt) ou différence de temps représente la différence de phase, ceux avec quoi on va déterminer la distance, alors que fD lui représentera la différence causée par l’effet Doppler selon si l’objet s’approche ou s’éloigne.

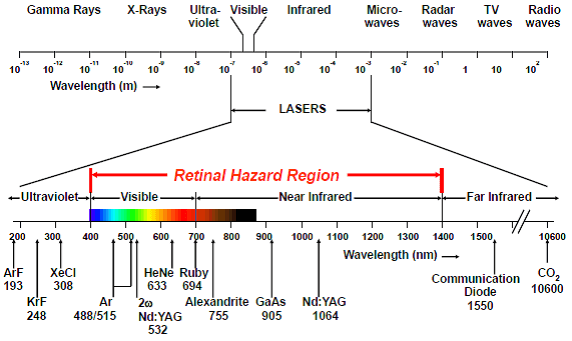

On va vite se rendre compte que c’est souvent des lasers qui sont utilisé, mais pourquoi ? Et pourquoi dans certains cas ce n’est pas nécessaires ?

Déjà, qu’est-ce qu’un laser ?

Un laser c’est un faisceau, pas forcément parallèle contrairement à ce que l’on pourrait penser, mais qui est monochrome et cohérent, c’est-à-dire qui n’as qu’une seule couleur/longeur d’onde, et que celle si sont alignées les unes aux autres :

Ce qui est parallèle ici c’est donc les ondes et non la direction du laser, car avec les lentilles adéquates, on peut facilement focusser ou défocusser un laser et lui faire prendre une forme connique.

Donc l’avantage c’est qu’on connait avec précision la longueur d’onde et qu’on va pouvoir cibler celle si précisément pour éviter les interférences extérieures, mais également que pour tout ce qui pourrait être sensible au changement de phase, ça rend le tout très simple a utilisé, surtout qu’une grande bande du spectre électromagnétique des Ultra-violets jusqu’à très loins dans les Infra-Rouges sont utilisable en tant que laser :

Le système le plus simple qui utilise le principe du ToF c’est le « rangefinder » ou « télémètre laser ».

Bien que certains fonctionne sur le principe du Structured Light, en général c’est du ToF, avec une simple diode ou une mini-caméra pour recevoir le laser et calculer la distance.

Tout cela n’est pas trop compliqué, la vraies difficultés c’est de réaliser qu’il y a pleins de façon différentes d’utiliser les ToF dans un LiDAR.

On va retrouver ce genre-là

La tête tourne à toute vitesse, et très régulièrement un capteur ToF va mesurer la distance, le corps de l’appareil tourne également mais plus lentement, résultat, on réalise une carte de type « point cloud » d’un environnement avec un seul laser.

Explications ici en Anglais :

https://www.youtube.com/watch?v=1lDO1UevAJI

Et les LiDAR étant maintenant de plus en plus présent dans l’automobile, sont un bon exemple des différentes versions qui existent :

Que ce soit avec un seul point qui va être utilisé avec une tête tournant très vite comme les fameux topographes, à d’autre scannant pixels par pixels ou par ligne.

Pour la suite, et bien, on retrouve pas mal qui, tel que celui sur l’iPhone, vont scanner de façon simultanée tout le champ de vision, certain vont projeter une grille de points, mais contrairement au style Structured Light qui mesure la triangulation, ils vont mesurer le temps que chaque points va mettre à revenir pour donner la distance.

Et la façon la plus complète c’est le Flash LiDAR qui illumine en un seul coup comme une lampe le ferait, en suite on va utiliser quelque chose de proche d’un capteur de caméra classique, bien qu’avec de l’électronique super rapide, et déterminer par pixels, le temps que ceux si ont mis à revenir.

L’évolution des LiDAR est résumée dans cette image :

Et on peut voir sur celle ci qu’il existe pleins de sous types de LiDAR :

C’est ça qui rend le tout compliqué, des fois les ToF sont leur propre type de capteur, tel que dans les télémètre lasers, et dés fois les LiDAR utilisent des ToF, et dans certains rare cas ils utilisent d’autre techniques tel que les Structured Light.

L’acronyme même du LiDAR a deux significations distinctes :

Light Detection And Ranging et Laser imaging, Detection, And Ranging.

Ce qui est sur c’est que les LiDAR sont définie par quelque chose qui va utiliser la lumière, la partie « ranging » définie le fait de mesurer la distance, par contre les parties « détection » et « imaging » peuvent être interprété.

Du fait que l’utilisation même d’un type de capteur peut en faire ou non un LiDAR, du même fait que les « Depth Sensors » (capteur de profondeurs) ne sont pas un type particulier de capteur, mais une utilisation d’un type, ToF, Structured Light ou même IA dans le cas d’autre méthodes tel qu’avec une seule caméra.

Le soucis c’est que les termes sont tellement utilisé de façon interchangeable, que c’est devenu un vrais enfer de déterminé qu’est ce qui est quoi…

Chapeau, voilà ce qui s’appelle un commentaire argumenté !